通用传感器怎样赋予机器人快速感知突发情况的应急能力?

通用传感器通过多模态感知技术构建机器人的环境认知框架,其核心在于融合视觉、力觉、声觉等多元信号,结合智能算法实现环境动态建模与风险预判。在应急场景中,传感器需突破传统单一感知局限,通过多源数据融合提升环境适应性,为机器人提供实时态势感知与决策支持。本文从技术原理、应用场景及优化路径三方面,解析通用传感器如何赋能机器人构建应急响应能力。

一、通用传感器的技术内核:多模态感知的协同效应

1.1 视觉传感:构建环境三维地图

视觉传感器通过激光雷达、结构光或双目摄像头,将物理空间转化为数字模型。激光雷达可实现远距离高精度测距,结构光擅长捕捉微米级表面形变,双目视觉则通过视差原理还原物体深度信息。在应急场景中,视觉系统需突破低光照、强干扰等限制,例如红外热成像可在浓烟中识别热源,多光谱传感器能穿透伪装层检测化学物质。

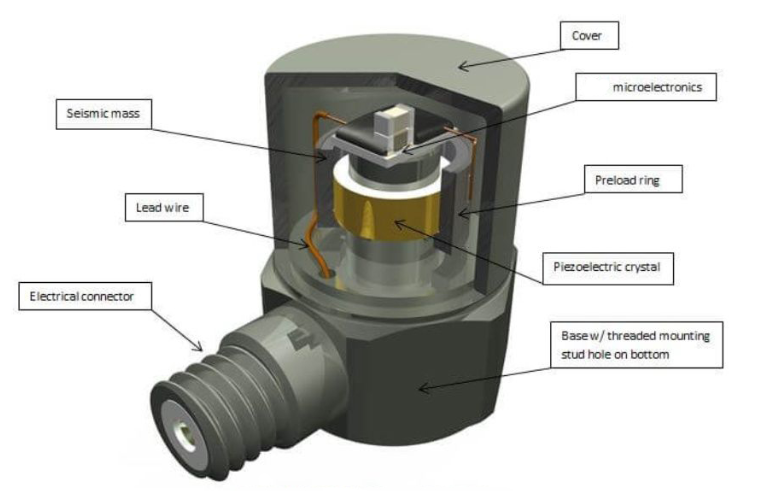

1.2 力觉传感:实现动态交互控制

力传感器通过电阻应变片或压电材料,将接触力转化为电信号。在机械臂抓取任务中,力觉反馈可避免因用力过猛导致物体破损,或因力度不足导致滑脱。在应急救援中,力传感器需具备高灵敏度与抗冲击性,例如在破碎墙体中钻孔时,需实时感知钻头受力变化以调整推进策略。

1.3 声觉传感:捕捉环境异常信号

声学传感器通过麦克风阵列与信号处理算法,实现声源定位与模式识别。在坍塌建筑中,微弱求救声可通过波束成形技术定位;在气体泄漏场景,超声波传感器可检测高频气流摩擦声;在火灾现场,声纹识别能区分火焰燃烧声与结构坍塌声,为救援决策提供依据。

二、应急场景下的感知瓶颈与突破方向

2.1 复杂环境下的信号干扰

在浓烟、强光或电磁干扰环境中,单一传感器易出现误判。例如,视觉传感器在粉尘中可能将颗粒误识为障碍物,力传感器在高温下可能因材料形变导致数据失真。突破方向在于多传感器融合:通过卡尔曼滤波或深度学习算法,将视觉、力觉、声觉数据交叉验证,构建鲁棒性更强的感知系统。

2.2 动态场景的实时响应需求

应急场景要求机器人具备毫秒级决策能力。例如,在避障任务中,传感器需在极短时间内完成环境扫描、障碍物分类与路径规划。优化路径包括:采用边缘计算架构降低数据传输延迟,开发轻量化神经网络模型提升推理速度,以及通过预训练模型实现场景快速适配。

2.3 长期任务的能源与可靠性挑战

在持续数小时的救援任务中,传感器需平衡功耗与性能。例如,激光雷达的高精度以高能耗为代价,而低功耗传感器可能牺牲分辨率。解决方案包括:开发自适应采样算法,根据任务阶段动态调整传感器工作模式;采用能量收集技术,利用环境光或振动为传感器供电;设计冗余传感系统,在部分组件失效时维持基础功能。

三、从感知到决策:构建应急响应闭环

3.1 环境建模:从数据到认知

传感器采集的原始数据需经过预处理、特征提取与语义标注,最终转化为机器人可理解的“环境语言”。例如,将视觉点云数据转化为障碍物边界框,将声学信号转化为声源位置与类型标签,将力觉数据转化为接触物体材质属性。

3.2 风险预判:基于感知的决策支持

通过机器学习模型,机器人可基于历史数据预测环境变化趋势。例如,在火灾场景中,结合温度梯度与烟雾扩散方向,预判火势蔓延路径;在地震救援中,根据建筑结构振动频率与位移数据,评估二次坍塌风险。

3. 3 人机协同:感知能力的延伸

在复杂任务中,人类操作员可通过远程接口补充机器人感知盲区。例如,操作员可手动标注视觉传感器未识别的关键物体,或通过力反馈设备远程控制机械臂完成精细操作。这种人机协同模式需解决通信延迟与操作意图理解等挑战。

总结

通用传感器通过多模态感知、抗干扰算法与智能决策系统,为机器人构建了应对突发情况的核心能力。从环境建模到风险预判,从单机感知到集群协同,传感器技术的演进正推动机器人从“执行工具”向“智能伙伴”转型。未来,随着新材料与新算法的突破,机器人将在更多极端场景中展现其应急价值。